Rocket.Chat AI fournit des informations sécurisées sur site qui respectent les règles de classification et d'accès à l'

, permettant ainsi aux équipes d'agir plus rapidement, de se fier à chaque réponse et de protéger les données critiques.

Une IA qui échappe à votre contrôle présente un risque pour la mission. Lorsque votre modèle n'est pas souverain, vérifiable ou conforme aux politiques de classification et d'accès, chaque réponse devient un risque pour les renseignements.

exposer des informations confidentielles lorsqu'ils opèrent en dehors de votre enclave sécurisée.

compromet les missions lorsque l'IA ne peut pas prouver la source, la filiation ou le contexte.

se produisent lorsque l'IA contourne les contrôles d'accès ou les limites de classification.

Rocket.Chat permet la collecte de renseignements opérationnels grâce à une IA souveraine, des modèles alignés sur la doctrine, un accès contrôlé et une provenance vérifiée, afin que chaque information soit fiable, conforme et prête à être utilisée.

Conservez toutes les informations à l'interne, enrichissez-les avec le contexte de la mission et gardez un contrôle total sur les données confidentielles exclusives.

Sovereign AI : Exécutez l'IA dans vos enclaves sécurisées tout en conservant un contrôle total sur les données et les connaissances, et en garantissant la sécurité de toutes les informations.

Flexibilité des modèles : prenez en charge n'importe quel modèle d'IA, y compris BYO LLM, pour répondre aux besoins de la mission tout en évitant la dépendance vis-à-vis d'un fournisseur.

Cycle de vie des connaissances : versionnez , expirez et réindexez automatiquement les données afin de garantir la fiabilité et l'actualité des informations.

Ingestion sécurisée : ingérez des données propriétaires en toute sécurité tout en les conservant entièrement contenues et protégées.

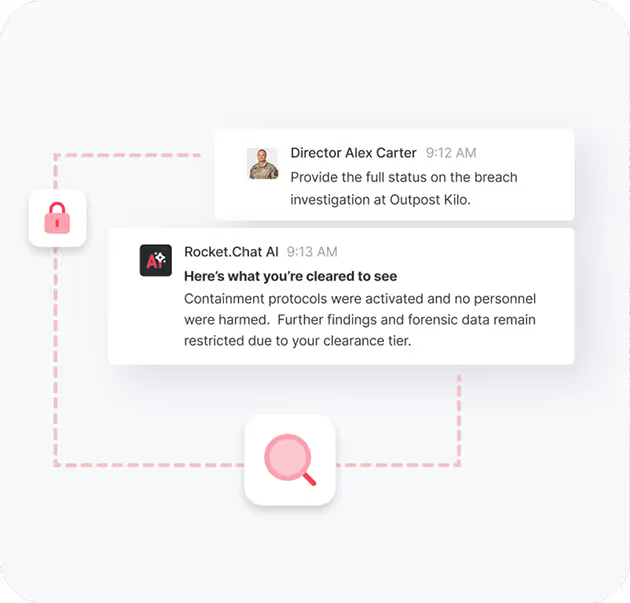

Veiller à ce que l'IA respecte les niveaux d'habilitation, les rôles et les politiques internes afin de garantir la protection, l'auditabilité et la conformité des renseignements sensibles aux normes de la mission.

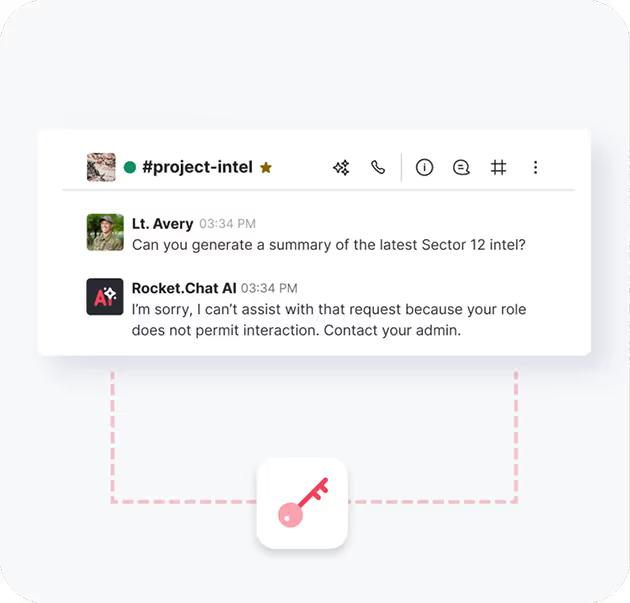

Veillez à ce que seul le personnel autorisé puisse déclencher des requêtes IA ou gérer les pipelines, afin de garantir la sécurité de toutes les opérations.

Afficher les messages d'alerte et appliquer les règles en matière de politique, de classification et d'habilitation afin d'empêcher les fuites de données.

Ne communiquez les informations issues de l'IA qu'aux utilisateurs autorisés, en respectant la sensibilité et la classification des données afin de protéger pleinement les renseignements.

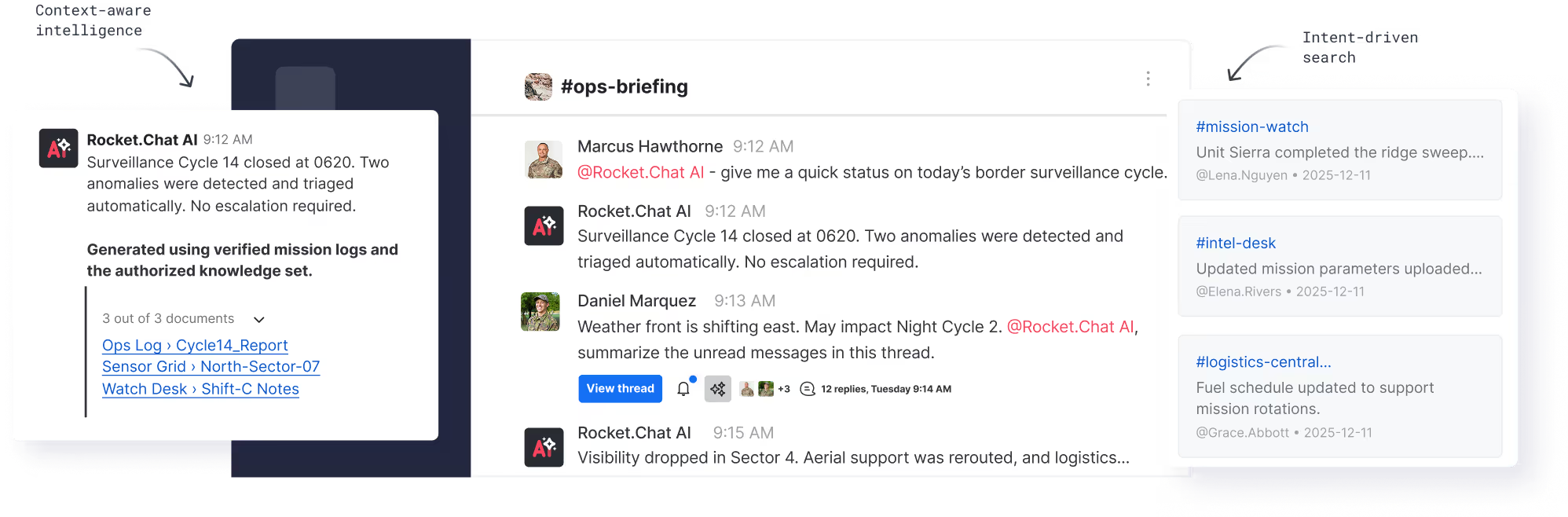

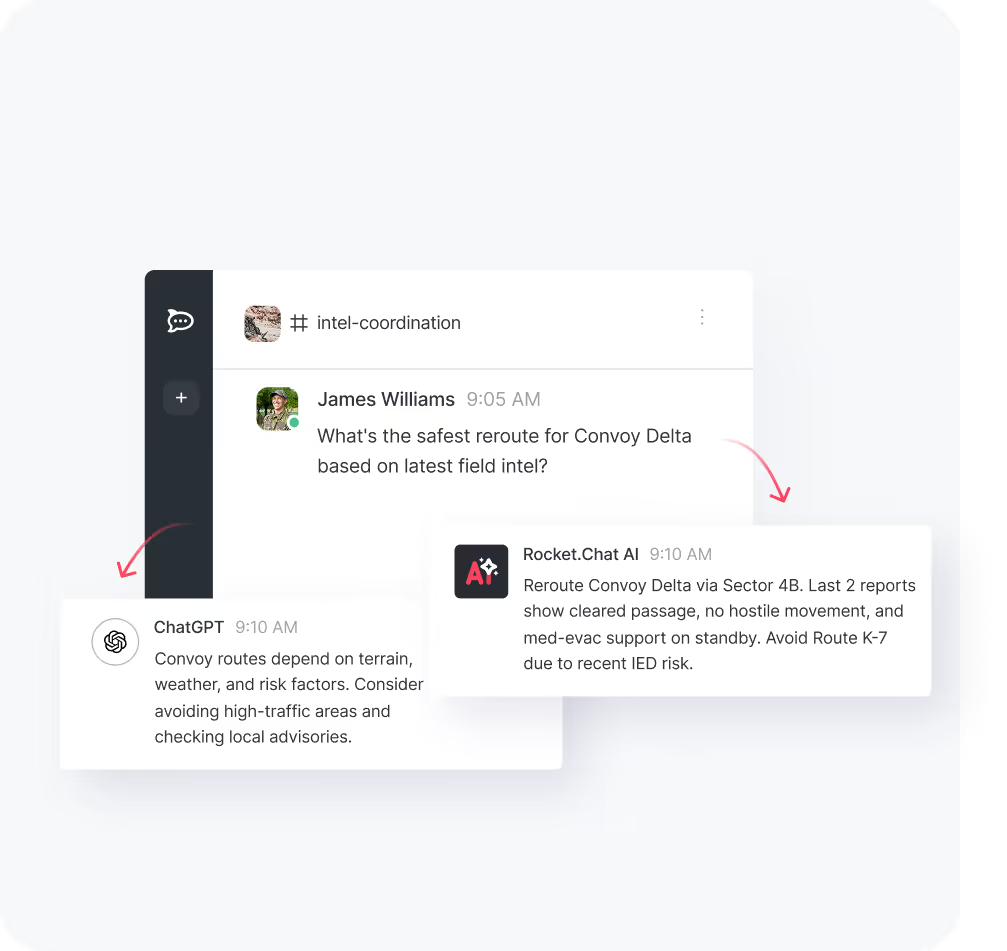

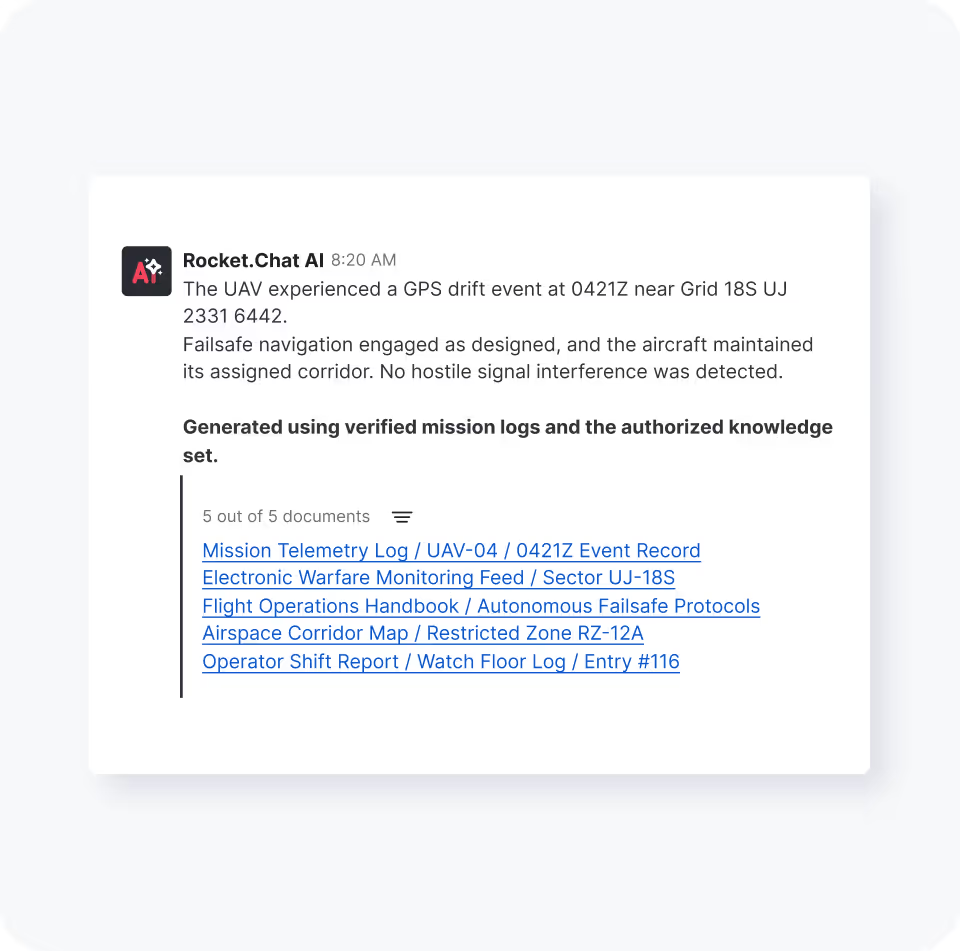

Transformez l'IA en un partenaire fiable plutôt qu'en une boîte noire. Fournissez des informations fondées sur des connaissances vérifiées, traçables jusqu'à leur source et immédiatement exploitables pour prendre des décisions urgentes.

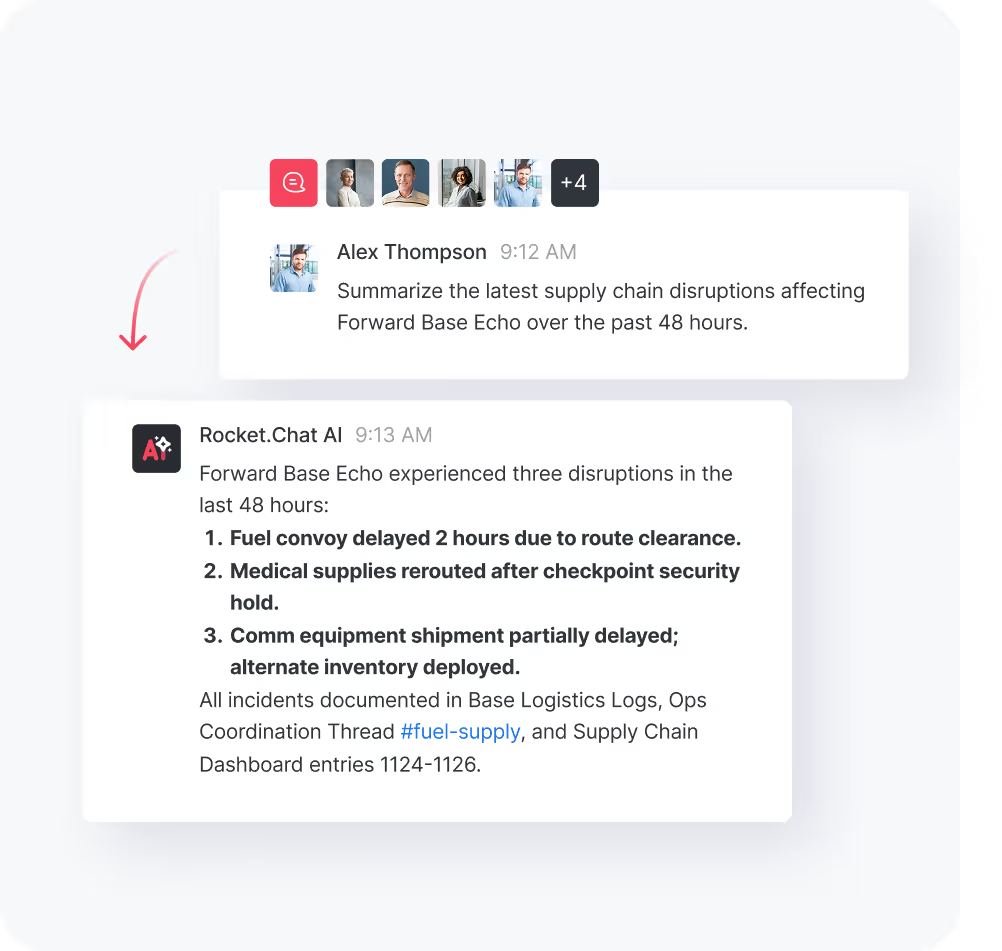

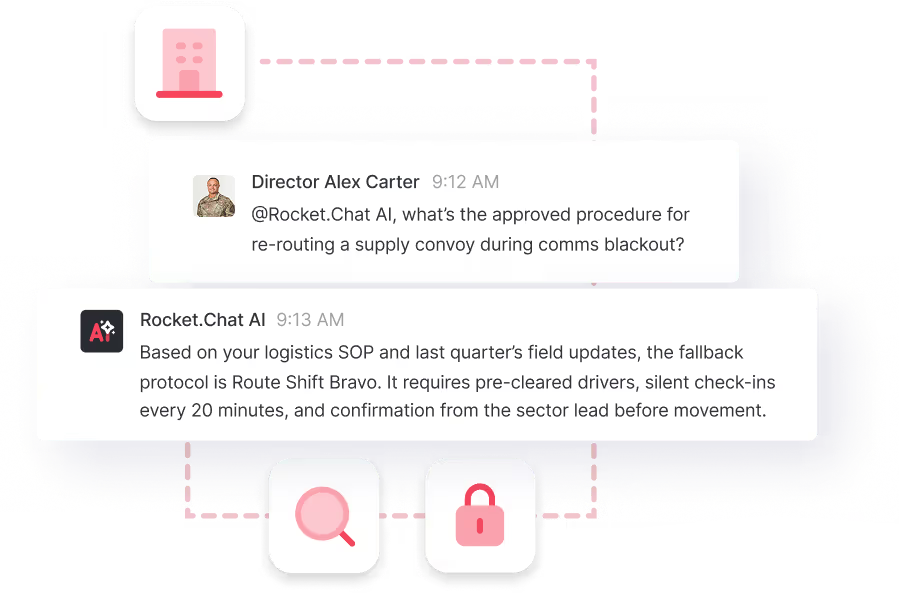

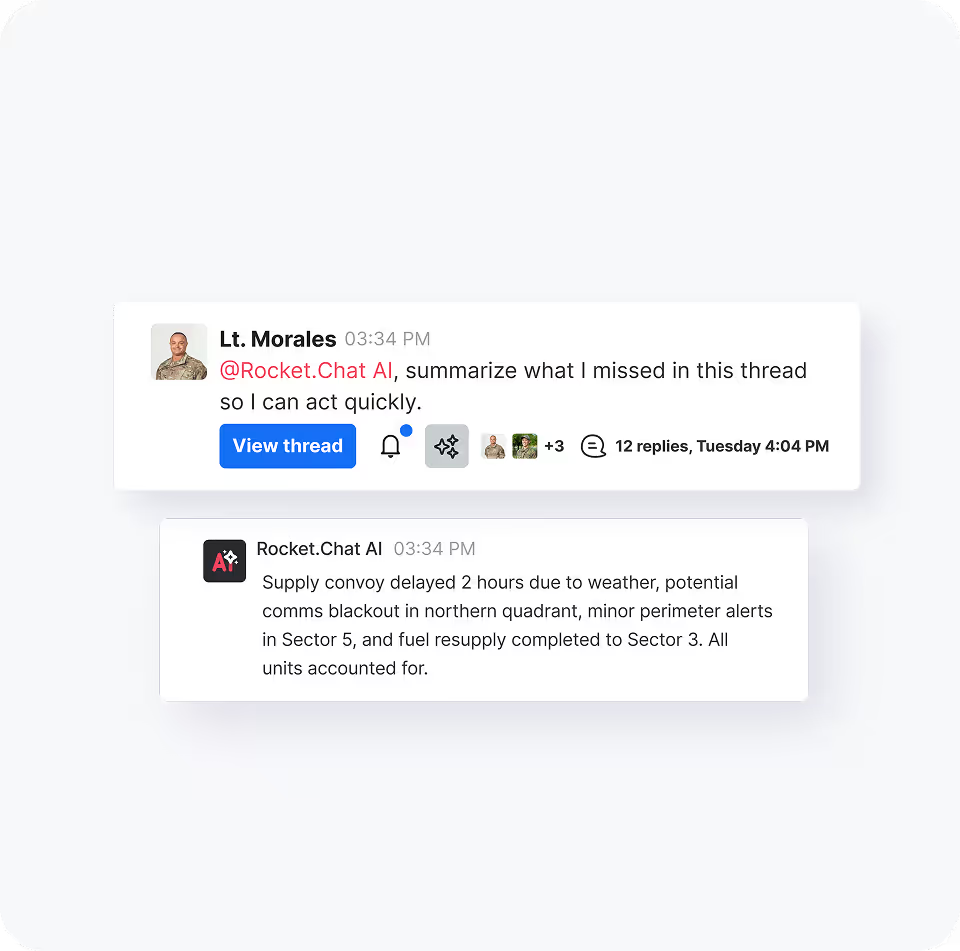

Tirez parti des connaissances internes, des guides stratégiques et des procédures opérationnelles standardisées afin que l'IA fournisse des réponses exploitables, pertinentes et riches en contexte, auxquelles les équipes peuvent se fier instantanément.

Retracez les réponses jusqu'à leurs sources, garantissant ainsi l'auditabilité et la confiance opérationnelle.

.avif)

Enrichissez les requêtes avec le contexte et l'historique pour obtenir des réponses précises dès la première fois, réduisant ainsi les allers-retours itératifs dans les missions à enjeux élevés.

.avif)

Fournissez des réponses incrémentielles et des traductions en temps réel pour prendre en charge des opérations multilingues sécurisées et à l'épreuve de l'

, toutes missions et langues confondues.

.avif)

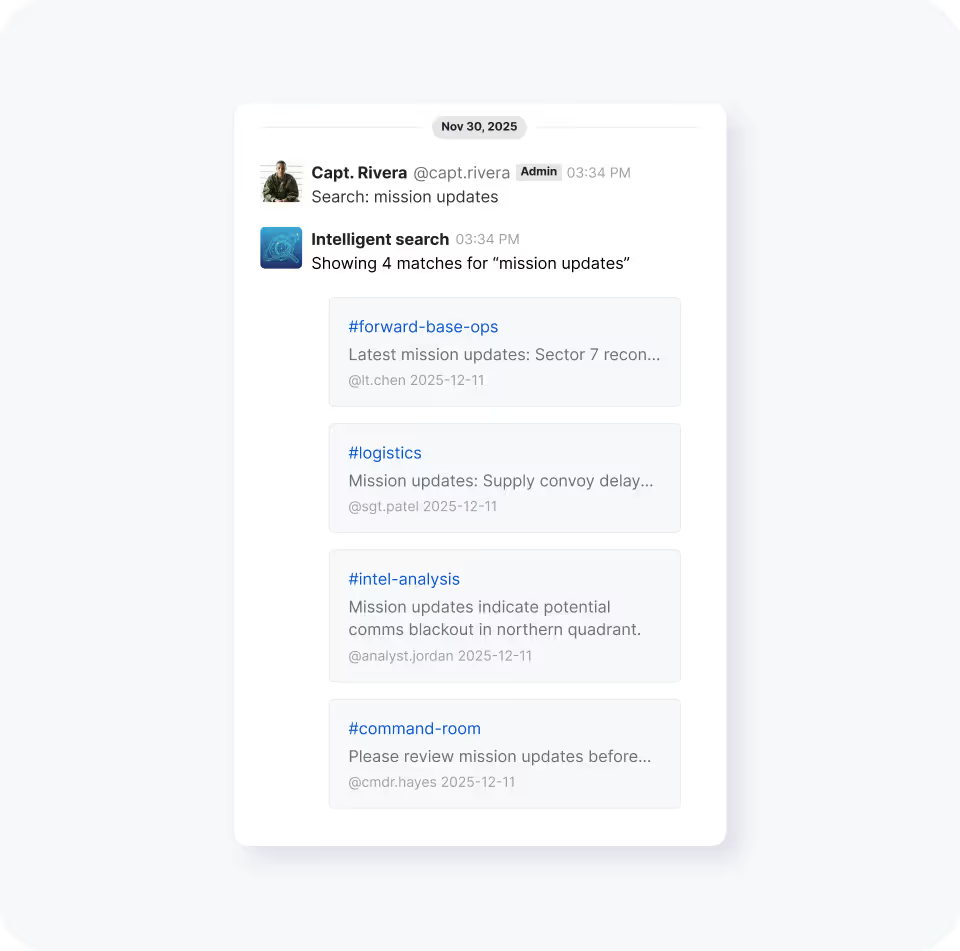

La recherche sémantique et la synthèse basée sur l'IA font ressortir les messages, les fils de discussion et les fichiers les plus pertinents dans votre espace de travail. Les résultats respectent les rôles et les politiques d'accès pour une récupération rapide et sécurisée.

.avif)

.avif)

Témoignage client

Dennis Wong, directeur et cofondateur, Master Concept

Rocket.Chat AI (RAI) est conçu pour les opérations à haut risque. Chaque choix de conception garantit la souveraineté, l'application des politiques et des renseignements vérifiables auxquels vos équipes peuvent se fier.

RAI fonctionne entièrement au sein de votre environnement, de sorte que toutes les données, les inférences et les récupérations restent sous votre contrôle.

RAI applique des contrôles RBAC, de classification et d'invite afin de garantir que les informations ne soient consultées que par des utilisateurs autorisés.

RAI utilise vos données exclusives en toute sécurité via RAG afin de fournir des réponses contextuelles et adaptées à votre mission.

Chaque réponse renvoie à sa source et à sa classification afin que les équipes puissent vérifier, sans se fier aveuglément.

La recherche comprend l'intention et le sens afin de lutter contre les silos d'informations et de faire rapidement apparaître les bonnes informations.

Les administrateurs contrôlent l'ingestion, l'indexation, la conservation et l'accès afin que l'IA reste conforme aux politiques de la mission.

.avif)

Prêt à commencer ?

Les gouvernements s'orientent vers la souveraineté numérique afin d'améliorer leur indépendance et de protéger leurs données contre les ingérences réglementaires extraterritoriales.

des gouvernements imposeront des exigences en matière de souveraineté pour l'IA d'ici 2028.

Gartner